【论文笔记】ECCV2020-2022 6D位姿估计相关论文

ECCV2020

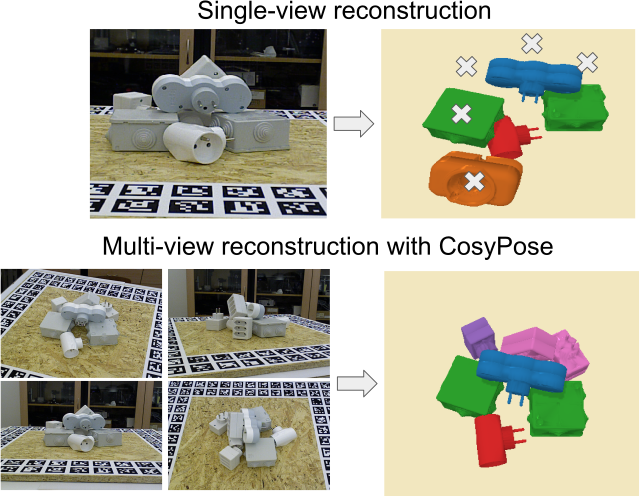

01. CosyPose: Consistent multi-view multi-object 6D pose estimation

期刊 / 会议:ECCV2020

作者 / 机构:Yann Labbe, Ecole normale superieure, CNRS, PSL Research University, Paris, France

关键词:位姿估计

时间:2020

代码:https://github.com/ylabbe/cosypose

1 目标问题

在相机位置未知的情况下,利用多视角信息来提高物体姿态估计的准确性和鲁棒性

2 方法

(1)建立6D姿态初始候选对象

给定一组具有已知3D模型的对象和场景的单个图像,我们为每个对象输出一组候选检测,并为每个检测输出对象相对于与图像相关联的相机的6D姿态。

(2)对象候选匹配

匹配多个视图中可见的对象,以获得单个一致的场景。

(3)全局场景细化

所有物体和相机的6D姿态都经过了优化,以最大限度地减少全局重投影误差。

3 思考

(1)创新点

- 提出了一种基于渲染和比较的单视角单物体6D姿态估计方法,用于生成每个图像中的物体姿态假设。

- 开发了一种基于RANSAC的鲁棒方法,用于匹配不同图像中的单个物体姿态假设,并利用这些对象级别的对应关系来恢复相机之间的相对位置。

- 开发了一种基于对象级别捆绑调整(object-level bundle adjustment)的全局优化方法,用于在所有视角下最小化重投影误差,并改善噪声单视角物体姿态。

(2)实用性

从多个视图中推测物体的6D位姿,对于抓取场景实用性较差。

ECCV2022

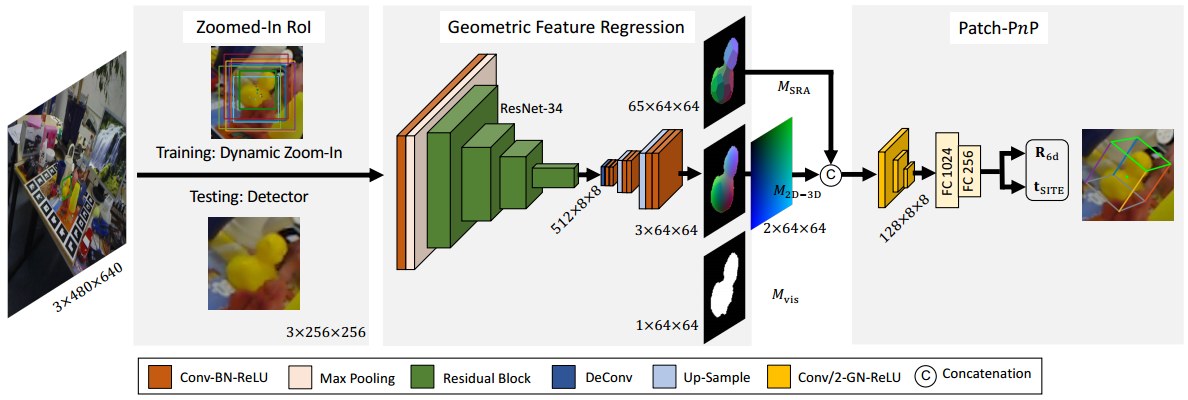

01. DProST: Dynamic Projective Spatial Transformer Network for 6D Pose Estimation

期刊 / 会议:ECCV2022

作者 / 机构:

关键词:

时间:2022

代码:https://github.com/parkjaewoo0611/DProST

数据集:LINEMOD

1 目标问题

提出了一种新的基于投影网格的姿态估计系统。

2 方法

- 使用深度神经网络从RGB图像中提取特征,并预测物体位置和大小。

- 在相机空间上根据预测位置和大小生成一个锥形光束网格,并将其反向变换到物体空间。

- 使用参考图像和掩码从物体模型或重建特征中提取纹理特征,并将其映射到变换后的网格上。

- 使用双线性插值从映射后的纹理特征中采样得到重建图像,并与输入图像进行比较。

- 使用基于网格距离和网格匹配损失函数来优化网络参数和姿态参数。

3 思考

深度神经网络提取特征,投影网格重建图像,使用损失函数优化参数。

02. DCL-Net: Deep Correspondence Learning Network for6D Pose Estimation

期刊 / 会议:ECCV2022

作者 / 机构:Hongyang Li, South China University of Technology, Guangzhou, China

关键词:位姿估计

时间:2022

代码:https://github.com/Gorilla-Lab-SCUT/DCL-Net

数据集:LINEMOD

1 目标问题

从点对应关系中直接估计6D物体姿态,而不是使用间接的对应学习目标

2 方法

这篇论文的主要方法是提出了一种新的深度对应学习网络(DCL-Net),它利用双重特征解耦和对齐(FDA)模块,在特征空间中建立相机坐标系和物体坐标系之间的部分到部分对应关系和完整到完整对应关系。具体步骤如下:

- 首先,对于部分物体观测和其CAD模型,分别提取它们的点特征图;

- 然后,设计两个FDA模块,分别建立部分到部分对应关系和完整到完整对应关系。具体来说,每个FDA模块将两个点特征图作为输入,并将每个特征图解耦为独立的姿态特征图和匹配特征图;然后利用匹配特征图学习一个注意力图来建立深度对应关系;最后,根据注意力图将两个系统的姿态特征图和匹配特征图进行对齐和配对,得到姿态特征对和匹配特征对;

- 接着,将两个FDA模块得到的两组对应关系进行融合,因为它们具有互补优势;然后利用融合后的匹配特征对学习置信度得分来衡量深度对应关系的质量;同时利用置信度得分加权融合后的姿态特征对来直接回归物体姿态;

- 最后,提出了一个基于置信度的姿态优化网络来进一步迭代地提高姿态精度。

3 思考

点特征方法。

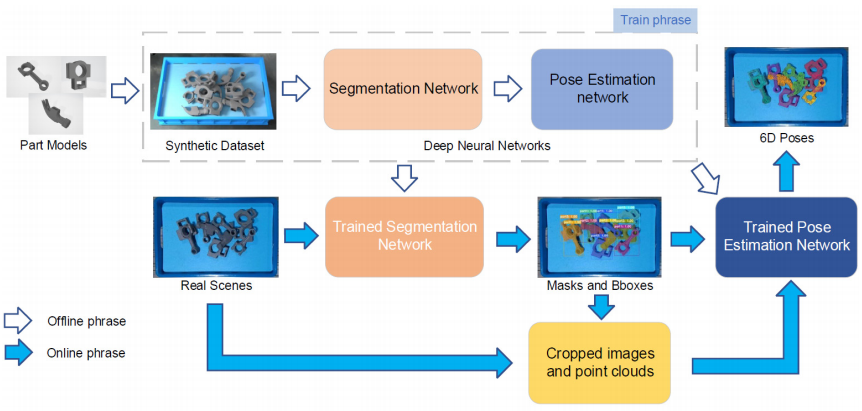

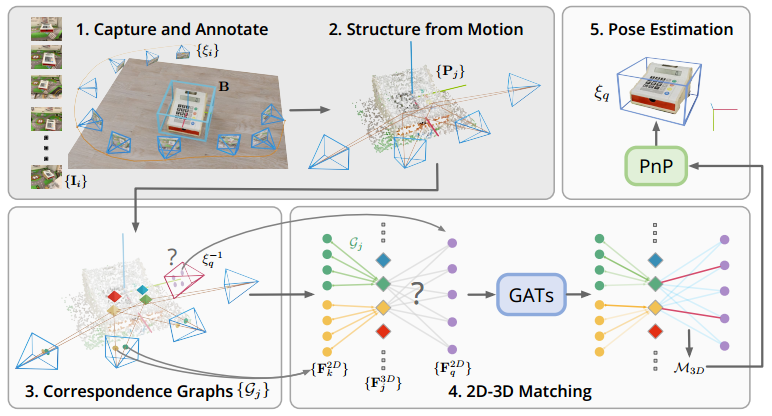

03. Perspective Flow Aggregation for Data-Limited 6D Object Pose Estimation

期刊 / 会议:ECCV2022

作者 / 机构:Yinlin Hu, EPFL CVLab, Lausanne, Switzerland

关键词:位姿估计;少数据情况

时间:2022

代码:https://github.com/cvlab-epfl/perspective-flow-aggregation

数据集:LINEMOD

1 目标问题

在数据有限的情况下,使用合成图像或少量真实图像来训练一个6D物体姿态估计的模型

2 方法

- 首先,利用合成图像和真实图像(如果有的话)来训练一个基于深度学习的特征提取器,用于从输入图像中提取出与物体姿态相关的特征。

- 然后,利用合成图像和真实图像(如果有的话)来训练一个基于透视流(perspective flow)的模块,用于将输入图像中的特征点映射到目标物体模型上。透视流是指由于相机和物体之间相对运动而导致的特征点在不同视角下的位移。

- 最后,利用一种称为透视流聚合(perspective flow aggregation)的技术,将多个透视流进行融合,并通过最小二乘法求解出最优的6D物体姿态。

3 思考

投影透视方法。

04. Learning-Based Point Cloud Registration for 6D Object Pose Estimation in the Real World

期刊 / 会议:ECCV2022

作者 / 机构:Zheng Dang, CVLab, EPFL, Lausanne, Switzerland

关键词:位姿估计

时间:2022

代码:https://github.com/AnsonYanxin/MatchNorm

数据集:LINEMOD

1 目标问题

2 方法

- 首先,它提出了一种基于深度学习的点云匹配模块,用于从源点云和目标点云中提取特征,并计算两个点云之间的相似度矩阵。

- 然后,它提出了一种基于归一化的点云对齐模块,用于根据相似度矩阵找到最佳的刚性变换矩阵,使得源点云和目标点云之间的距离最小化

3 思考

代码不完全。